Ceci est une ancienne révision du document !

Flux - Stable diffusion

Stable diffusion permet de générer des images, open source il permet de générer des images a partir de texte ou d'autres images gratuitement sur un ordinateur offline, il permet aussi de créer des apprentissage pour créer ses propres modèles et générer des vidéos.

Installation

Pour installer SD il faut un ordi récent, Windows ou mac avec une carte graphique adequate >RTX 3070. Il faudra aussi installer Python, Git bash , et télécharger des fichiers assez lourd via HugginFace et d'autres dépots.

Temps d'installation, prévoir 1 à 2 heures de galère potentielle.

- https://pinokio.computer/ Installation facile avec Forge qui installera flux, mais permettera aussi Stable Diffusion en telechargeant des modeles checkpoint

Plusieurs interfaces de contrôle sont disponibles, la plus utilisé se nomme A1111 ou Comfy ui

- https://github.com/invoke-ai/InvokeAI plus user friendly …

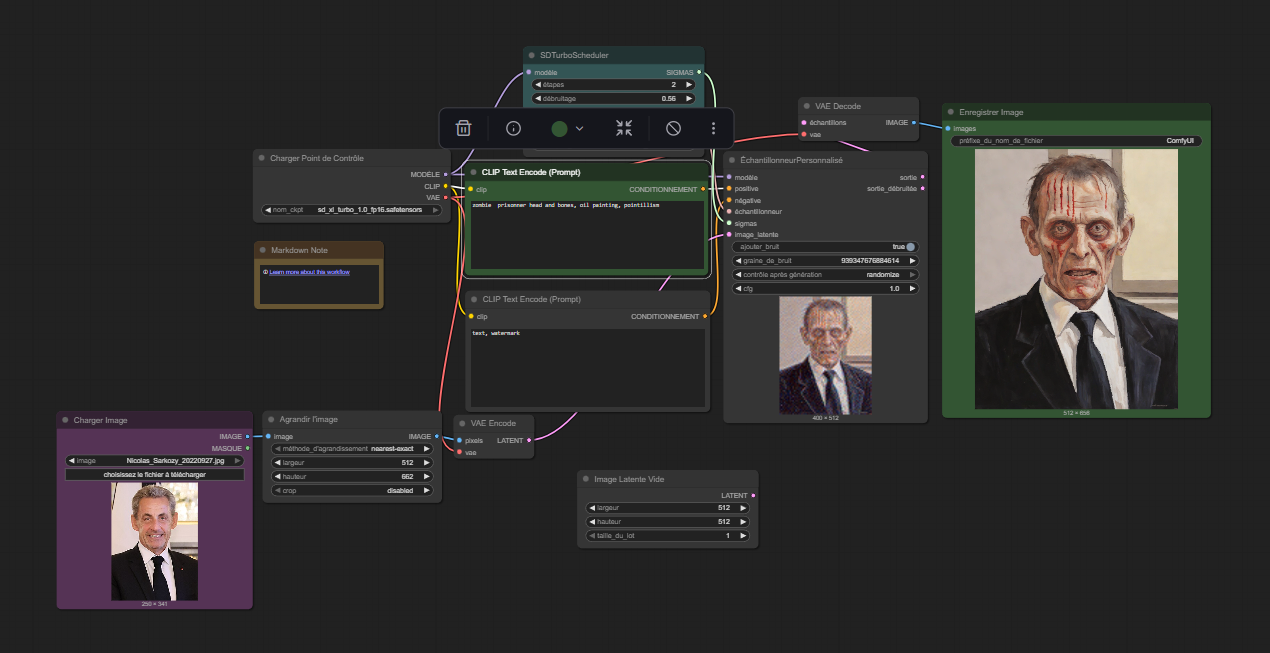

- ComfyUi en nodal

Comfy ui

Installation : Vous pouvez utiliser SwarmUI (https://swarmui.net/) pour une installation facile.

Ensuite, ouvrez l'espace workflow où un exemple de workflow Stable Diffusion (SDXL) est disponible.

Dans l'onglet “Templates”, vous pouvez voir d'autres workflows téléchargeables avec différents modèles (Z image / Flux/ Wan…). En cliquant sur un workflow, il s'affiche, et s'il manque des modèles, il propose de les télécharger (mais veillez à les mettre dans les bons dossiers, car certains sont différents de ceux annoncés, par exemple : Text Diffuser → CLIP).

Aussi, si certains nœuds manquent, il faut installer le plugin “Manager” (https://github.com/Comfy-Org/ComfyUI-Manager). Celui-ci permet de télécharger les bibliothèques manquantes et de faire les mises à jour facilement.

Les modèles d'images

Les modèles d'images sont des fichiers qui compile des milliers d'image et leur description, certains sont orienté photo, dessin animé, manga … Un modele est lourd et pese généralement quelques gigas.

Il ya aussi des modeles pour certains plugin comme controlnet :

Plugins utiles

- Control net

- Dreambooth

- Roop

- Upscaler ..

Flux - skin

Pour rendre plus realiste une image généré par flux. Regenere l'image avec SD (un model special photo realiste) en img2img avec ces parametres :

- Steps: 34,

- Sampler: DPM++ 2M, Schedule type: Karras,

- CFG scale: 7,

- Model: epicphotogasm_amateurreallife,

- Denoising strength: 0.34,

Entrainement avec vos images

Il est possible de creer des LORA pour FLux ou SD.

Via pinokio, l'appli Fluxgym marche bien avec qqs images (entre 5 et 20)

Utilisation dans Forge

Steps: 20, Sampler: Euler, Schedule type: Simple, CFG scale: 1, Distilled CFG Scale: 3.5, Model: flux1-dev-bnb-nf4-v2, Diffusion in Low Bits: Automatic (fp16 LoRA)

Entrainement LORA z-image

Encore plus performant !

Générer des videos

On peut générer des videos ou suite d'images à partir d'une video source et un prompt (texte ou image). Via ComfyUI (sur swarm ui) des workflow avec WAN sont disponible et efficace. (necessite Gpu >12go de Vram)

Kohya-ss install

Attention il faut installer une version python 3.10.9 et click sur add to path ! (eventuellement faire le menage si windows nous force sur une mauvaise version de python ) puis telecharger le git

Extra Links

Control net Guide : https://stable-diffusion-art.com/controlnet/